Introducción a la Inteligencia Artificial - 2010

1

INTRODUCCIÓN A LA INTELIGENCIA ARTIFICIAL

MÓDULO 1: FUNDAMENTOS DE LA INTELIGENCIA ARTIFICIAL

1.1 INTRODUCCIÓN

Muchas de las actividades mentales humanas, tales como escribir programas de cómputo,

demostrar teoremas, razonar con sentido común y aún conducir un vehículo, normalmente se dice que

requieren “inteligencia”. Durante las décadas pasadas se ha logrado construir programas que pueden

realizar tareas como esas. Existen programas que pueden diagnosticar enfermedades, resolver

ecuaciones diferenciales en forma simbólica, analizar circuitos electrónicos, entender en forma

limitada frases habladas y escritas o escribir programas de cómputo cumpliendo especificaciones. Se

puede decir que tales sistemas poseen cierto grado de Inteligencia Artificial (IA).

En sus orígenes, la construcción de estos sistemas fue, en gran medida, experimental, con una

orientación ingenieril. Sin embargo los objetivos y las expectativas que despertó, tanto en los

protagonistas como en la comunidad científica, excedieron largamente los resultados obtenidos. Tal es

así que, a mediados del siglo pasado, (solo pocos años después que estuviera en funcionamiento la

primera computadora electrónica a válvulas) existían destacados científicos en el área de la IA que

hacían afirmaciones temerarias como la siguiente:

Sin afán de sorprenderlos y dejarlos atónitos, debo informarles lisa y llanamente que

actualmente en el mundo existen máquinas capaces de pensar, aprender y crear. Además, su

capacidad para hacer lo anterior aumentará rápidamente hasta que –en un futuro previsible- la

magnitud de problemas que tendrán capacidad de manejar irá a la par con la capacidad de la mente

humana para hacer lo mismo. (Herbert Simon, 1957, Premio Nobel de economia,1978, por sus

trabajos en la Teoría de las decisiones).

¿Pero cuales son tales máquinas maravillosas que son capaces de realizar las funciones más

elevadas del cerebro humano?

¿Qué es una computadora? ¿Es sólo una fábrica de números?

1 Tiene uno o más dispositivos de Entrada (teclado, ...)

2 Tiene uno o más dispositivos de salida (pantalla, ...)

3 Dispositivo de memoria (Ram, ...)

4 Una unidad aritmética

5 Una unidad de control

6 Un programa (instrucción de ruptura de secuencia)

Con esta “sencilla” máquina descripta por John V. Neumann (Principio de construcción del

ordenador) y con el auxilio de algunos mecanismos conocidos desde la época de la triada Sócrates-

Platón-Aristóteles (Ética a Nicómano) 400 años AC tales como los silogismos o el Modus Ponens que

permiten garantizar la veracidad de ciertas afirmaciones se pretendía resolver todo tipo de problemas,

como lo hace una persona.

Introducción a la Inteligencia Artificial - 2010

2

Pero, ¿es posible que las computadoras piensen?

• No, si uno define el pensamiento como una peculiar actividad del cerebro humano.

Cualquier comportamiento similar en una computadora debería designarse como

comportamiento “similar” al pensamiento.

• No, si uno define al pensamiento como algo inescrutable, misterioso o mítico.

• Sí, si uno admite que la pregunta debe ser contestada por experimentación y observación

Los dos NO son dogmáticos, el SI es empírico y práctico y es explorado por Alan Turing.

El Test de Turing (Computing Machinery and Intelligence,1950) para establecer si una máquina es o

no inteligente consiste en interrogarla por medio de una teletipo (sin contacto físico). El evaluador no

debe poder discernir si el que responde es una máquina o una persona.

Este planteo puede ser descripto en términos del llamado “Juego de la Imitación” que traslada

el peso de la respuesta desde la esencia (ser o no ser) a la apariencia (como si).

Se puede decir que la IA nace antes que la primera computadora electrónica como la rama de

las ciencias de la computación que se ocupa de construir sistemas que permitan exhibir un

comportamiento cada vez más inteligente, o que observado en un ser humano pueda ser calificado

como inteligente (Feigenbaum)

Algunas definiciones.

1- Hacer que las máquinas hagan cosas que requerirían inteligencia si fueran hechas por el hombre.

M. Minsky

2- Intentar hacer las computadoras más útiles y entender los principios que hacen posible la

inteligencia. Winston

3- Entender y estudiar científicamente los procesos comunes que subyacen en el pensar y el percibir

ya sea en el hombre como en la máquina. N. Nilsson

4- Es la parte de la ciencia de la computación que investiga los proceso de razonamiento simbólicos y

no algorítmicos y la representación de conocimiento simbólica para su uso en máquinas

inteligentes. Buchanan – Feigenbaum

Las definiciones anteriores de inteligencia son recursivas, siguen empleando la palabra

inteligencia, que etimológicamente deriva de la voz latina “legere” que significa recolectar y por lo

tanto elegir lo que sirve y separarlo de lo que no sirve, “intellegere” significa elegir entre varias cosas

potencialmente útiles y quedarnos con la mejor.

Inteligencia sería entonces la capacidad de discernir, discriminar, evaluar pero a medida que el

conocimiento humano se fue ampliando, el concepto de inteligencia fue abarcando cada vez mayor

cantidad de facetas del comportamiento no automático o repetitivo, cada vez mas asociado a la

resolución de problemas, al aprendizaje y al proceso creativo.

Muy Pronto los métodos que demostraban funcionar en ejemplos sencillos, fallaban en

problemas de mayor dificultad.

Lograban resultados gracias a manipulaciones sencillas, por ejemplo Eliza de Weizenbaum

(1965) manipulaba sintácticamente las oraciones que el mismo “interlocutor” le proporcionaba.

Introducción a la Inteligencia Artificial - 2010

3

El General Problem Solver (GPS, 1972, Human Problem Solving, Newels and Simon, 1960)

implementa el “mean and end analysis” (análisis de medios y fines) que clasifica a las cosas por

función. Entonces dado un objetivo se pueden encontrar sub objetivos y así siguiendo se puede llegar a

la solución cuando los sub objetivos son los medios disponibles para la solución del problema. Aunque

útil, quedan huecos cuando no hay acción para obtener lo que se desea o existen varias.

Al comienzo se pensó que la traducción automática de textos se lograría con un buen

diccionario, sencillas transformaciones sintácticas y siguiendo las reglas gramaticales de ambos

idiomas. Pero los fracasos no tardaron en convertirse en célebres como la retraducción del inglés al

ruso de la frase “The sprit is willing but the flesh is weak” (El espíritu es fuerte pero la carne es débil)

cuyo resultado nuevamente en ingles fue “The vodka is good but the meat is rotten” (El Vodka está

bueno pero la carne está podrida).

La intratabilidad de algunos problemas aún sencillos y muy bien definidos como el Travelling

Salesman Problem (TSP, el problema del viajante de comercio), que con problemas de micromundos y

pocas reglas funcionaban, pero con unos pocos nodos la solución podía tardar años en encontrarse.

Con la teoría de la completitud NP (Karpp 1972), la explosión combinatoria ( a.10

n

) del espacio de

soluciones se afianzó como una barrera física para la “brute force” y las esperanzas de que el avance

de la técnica micro electrónica resolvería el problema con la construcción de una batería de súper

computadoras en paralelo.

En 1963 McCarthy logró un algoritmo completo para la demostración de teoremas para la

lógica de primer orden apoyándose en el método de “resolución” descubierto por Róbinson, pero la

indecidibilidad de la lógica de primer orden (teoría de la incompletitud , Gödel 1931), al predecir que

existen aseveraciones verdaderas en las que no es posible decidir la validez mediante ningún

algoritmo, las demostraciones automáticas dependen de la “suerte”, que cuando es mala, el tiempo

puede ser indefinido (infinito).

A estos primeros métodos se los llamó “débiles” porque tenían poca información específica y

por medio de pasos elementales se pretendía llegar a soluciones importantes, a pesar de sus objetivos,

los resultados eran pobres.

Así alrededor de los 70 se plantea un nuevo enfoque, se construyeron sistemas basados en el

conocimiento (KBS Knowledge Based Systems). Reunían mucha información de un dominio

específico, donde hubiera un experto que pudiera indicar como manipular la información disponible

por medio de reglas simples del tipo “si A – entonces B”. A estos sistemas se los llamó “Sistemas

Expertos” en la pretensión de simular el comportamiento de un experto humano, en un área muy

técnica y específica. Se construyeron sistemas (Dendral) para determinar la estructura molecular de

compuestos orgánicos a partir de la información de un espectrógrafo de masas, otros como Mycin para

la determinación de infecciones en sangre, que tenía incorporado un calculo de incertidumbre

denominado factores de certeza. En cambio Prospector fue diseñado para colaborar con la localización

de yacimientos de Molibdeno.

Para poder operar con el conocimiento es necesario representarlo y poder hacer un modelo del

mundo sobre el cual se quieren hacer inferencias. Surgen así distintos métodos de representación del

conocimiento en forma simbólica, como la lógica de primer orden, los frames (marcos o planillas), las

redes semánticas, los objetos, etc. Lenguajes que puedan operar con estos paradigmas de

representación como Lisp y Prolog, Smalltalk, y shells especiales.

Hoy se puede hablar de varios tipos de inteligencia. Pero para las ciencias de la computación se

presupone “inteligente” como sinónimo de “racional”, no importando que sea o parezca.

Introducción a la Inteligencia Artificial - 2010

4

Esta definición evasiva relega a la IA a la frontera de las ciencias de la computación, todo

sistema de cómputo que en sus orígenes pudo ser considerado inteligente, al cabo de cierto tiempo deja

de serlo como lo demuestran innumerables ejemplos de sistemas como el Fortran, Traductores

Automáticos, Programación orientada a objetos, Administración automática de memoria, Listas

enlazadas, Tiempo compartido, Entornos de programación gráficos, Intérpretes interactivos, etc.

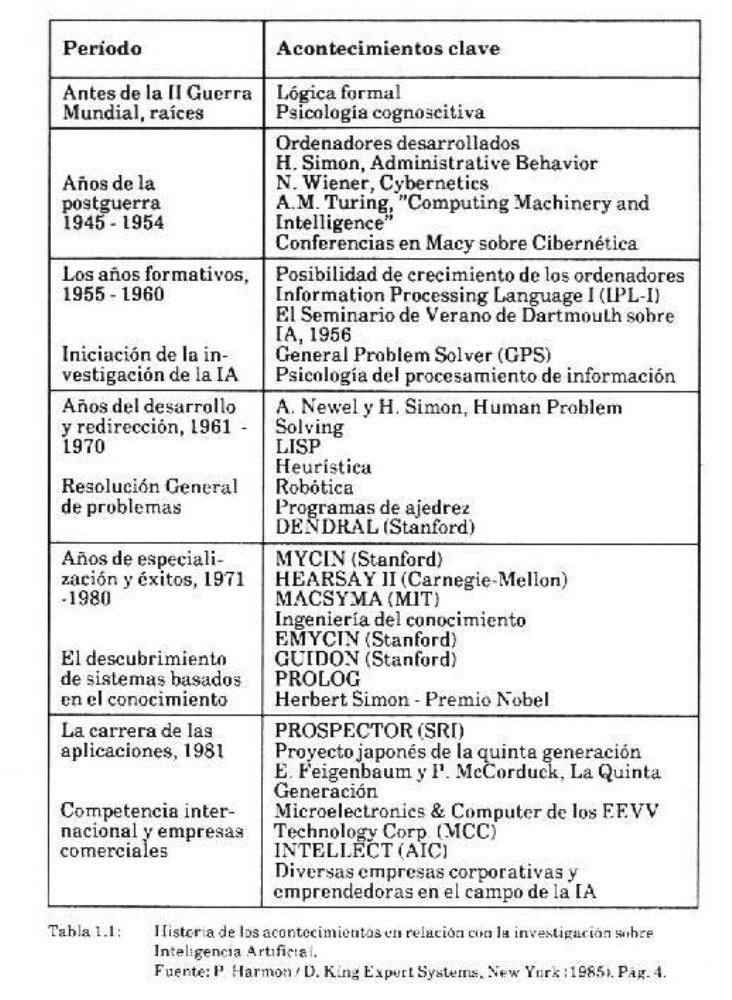

En la Tabla 1.1 se puede apreciar algunos acontecimientos importantes en la historia de la

Inteligencia Artificial.

Actualmente los desarrollos se apoyan en teorías más rigurosas, en lugar de plantear soluciones

intuitivas en la esperanza de que por error, azar o magia el resultado sea mejor que el “programa”.

Introducción a la Inteligencia Artificial - 2010

5

Físicos como Hopfield (1982) aplicaron técnicas de mecánica estadística y técnicas de

aprendizaje como el algoritmo de “backpropagation”. Así permitieron un resurgimiento de las Redes

Neuronales. La teoría de la evolución de Darwin y la demostración del teorema de “Schema” hacen

que los Algoritmos Genéticos y los Programas Evolutivos sean una disciplina con sólidas bases. La

teoría de modelos doblemente estocástcos de Markov (HMM Hidden Markov Model) aplicada al

reconocimiento de voz permitió por primera vez la construcción de sistemas comerciales de lenguaje

natural, con alto grado de eficiencia. El establecimiento formal de lógicas multivaluadas como la

Logica Difusa (Lotfi Zade), redes epistémicas (Dempster-Shefer), permite realizar sistemas de control

difuso que operan eficientemente, aún en aplicaciones donde la planta es alineal o no hay un modelo

ajustado. Los métodos de procesamiento de imágenes en forma digital junto con herramientas

matemáticas como Laplacianos y la transformada de Hough, permiten sistemas la aplicación de visión

artificial para la industria en tareas de seguridad, control de calidad, robótica móvil, etc.

¿Pero las computadoras hacen exactamente lo que se les ha dicho que hagan y NADA MÁS?

Este juicio es intuitivamente obvio, indudablemente cierto, pero no apoya ninguna de las

implicaciones que se derivan comúnmente de ella. Desde un punto de vista mecanicista los seres

humanos pueden pensar, aprender, y crear gracias a su programa biológico heredado, junto a los

cambios que ese programa produce por interacción con el ambiente. Si una computadora pensara,

aprendiera, creara, sería en virtud de un programa que la habilitara para esas capacidades.(Simon

1960).

Pero es incorrecto pensar que el programador puede predecir completamente todo el

comportamiento de su programa. La programación ha sido siempre la cruz y el tormento de los

investigadores y expertos, costosa en tiempo y esfuerzo propensa a fallos y difícil de corregir.

Actualmente el uso de Software en aplicaciones críticas como en la industria nuclear, es muy

limitado, porque no se puede calcular la confiabilidad de un programa de computación, sólo se puede

asegurar la calidad por la forma en que fue escrito y algunas pruebas no exhaustivas.

Alguien podría pensar que así como no podemos garantizar que los programas funcionen

exactamente para lo que fueron programados y realicen operaciones inesperadas, también por “error”

esas cosas “inesperadas” pueden resultar más útiles o inteligentes que las esperadas. La computación

evolutiva explota esta idea de búsqueda al azar de soluciones a problemas para los cuales no se ha

escrito un programa específico.

Las computadoras digitales son dispositivos universales que pueden ser clasificadas como

“Autómatas Finitos”, pero la complejidad del mundo, aun cuando ese mundo este perfectamente

estructurado como podría ser un juego, excede en mucho la posibilidad de explorarlo completamente

en busca de una solución. En el ajedrez, por ejemplo, se ha estimado que explorar exhaustivamente

todas las posibles jugadas de una partida es del orden de 10

120

, si consideramos que el Big Bang

ocurrió hace 15 10

9

años y disponemos de computadoras que pueden calcular una jugada en 10

-12

seg

(suponiendo un clock de 1 tera hertz y 1 instrucción por jugada), desde entonces hasta ahora habría

calculado 4,7 10

31

jugadas. Entonces un programa que se comporte en forma inteligente deberá buscar

la solución en forma muy selectiva explotando caminos prometedores y purgando ramificaciones

estériles.

Los programas heurísticos (regla empírica), toman ventaja de trucos para limitar drásticamente

el espacio de búsqueda de una solución que sea suficientemente buena la mayoría de las veces.

Introducción a la Inteligencia Artificial - 2010

6

2.1 PRINCIPALES ÁREAS DE LA I.A.

Las definiciones anteriores implican que las máquinas para ser consideradas inteligentes deben

exhibir ciertas habilidades, suficientemente complejas como para ser tratadas como áreas

independientes. La forma de abordaje de cada una de estas áreas suele ser tan disímil, que es difícil

reconocerles un origen común.

1- Procesamiento del Lenguaje Natural.

2- Consulta inteligente de base de datos.

3- Robótica.

4- Programación Automática.

5- Sistemas Expertos.

6- Prueba automática de teoremas y matemática simbólica.

7- Problemas de optimización combinatorios y de itinerarios.

8- Percepción y reconocimiento de patrones.

9- Autoaprendizaje.

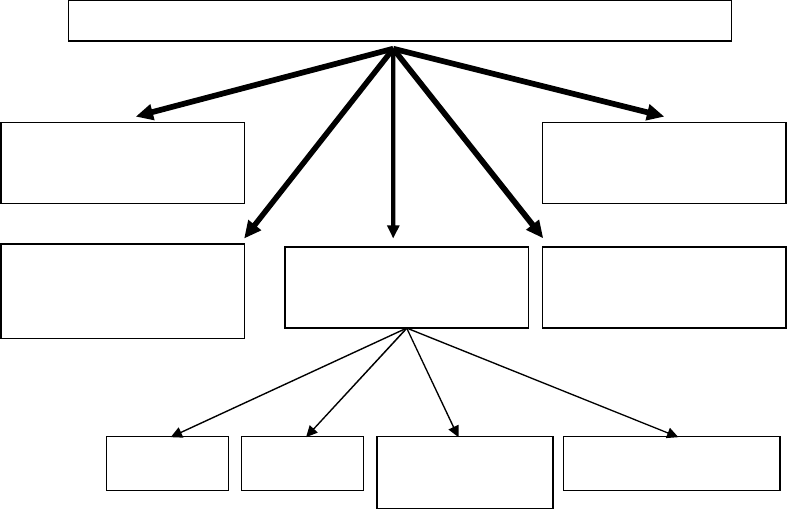

Cada una de estas áreas desarrolla modelos y herramientas que en la mayoría de los casos se

apoyan en programas de computadora originando nuevas maneras de programarlas, esto da origen a

nuevos modelos computacionales. En la fig1.1 se puede ver un resumen.

Figura 1.1 Nuevos modelos Computacionales

Estos nuevos modelos computacionales son los que permiten una nueva (distinta) forma de

programar computadoras, y pasar de las formas algorítmicas (o procedurales) a las formas no

algorítmicas (o declarativas). Se puede decir que se pasa del procesamiento de datos al procesamiento

de conocimientos.

NUEVOS MODELOS COMPUTACIONALES

SISTEMAS DE

PRODUCCIÓN

REDES

NEURONALES

PROGRAMACIÓN

ORIENTADA A

OBJETO

PROGRAMACIÓN

FUNCIONAL (LISP)

PROGRAMACIÓN

LÓGICA

DIFUSA MODAL

EPISTIÉMICA

(conocimiento)

PROPOSICIONAL

Introducción a la Inteligencia Artificial - 2010

7

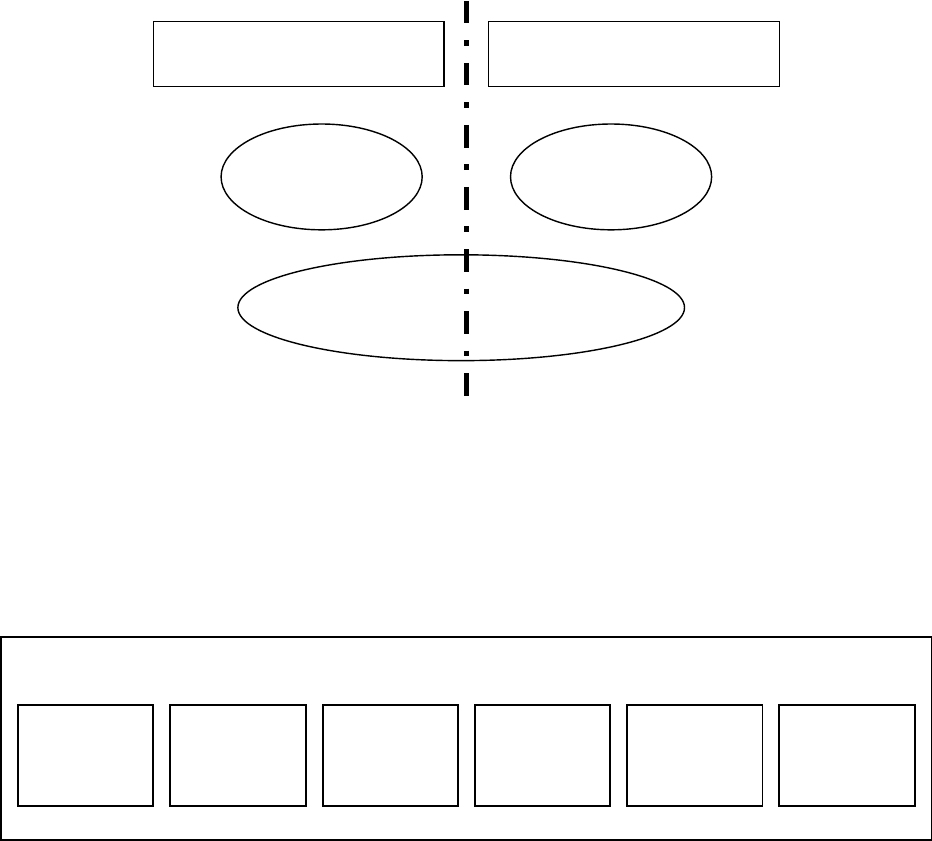

Figura 1.2 Transición del procesamiento de datos al procesamiento de conocimiento

Estas nuevas formas de programar nos permite abordar problemas que de otra manera sería mas

difícil o imposible abordarlos, hay algunos campos que ya han madurado lo suficiente como para

desarrollar técnicas y herramientas con las cuales se pueden abordar problemas en forma más o menos

rutinaria.

Figura 1.3 Subcampos de la Inteligencia Artificial

Referencias: Computers and Thought - Feigenbaum and Feldman - The MIT press - 1995

Inteligencia Artificial, un enfoque moderno – Russell and Norvig – Pearson Education - 2004

Técnicas de Inteligencia Artificial

Procesamiento de datos

Procesamiento de

conocimiento

Métodos

algorítmicos

Búsqueda

inteligente

Datos Conocimiento

Sistemas

de lenguaje

natural

Reconoci-

miento de

imágenes

Robótica

Sistemas

expertos

Algoritmos

genéticos

Lógica

difusa

16/03/2015

1

Introducción a la

Inteligencia Artificial

1

Ilustración: Hernán Juárez

Profesores:

Claudio Verrastro

Juan Carlos Gómez

Introducción a la Inteligencia

Artificial - 2012

Pensar...

2

Las leyes que tenemos que examinar son las de

una de nuestras facultades mentales mas

importantes. Las matemáticas del intelecto

humano. George Boole 1854

Introducción a la Inteligencia

Artificial - 2012

16/03/2015

2

Expectativas

Sin afán de sorprenderlos y dejarlos

atónitos, debo informarles lisa y

llanamente que actualmente en el

mundo existen máquinas capaces

de pensar, aprender y crear.

Además, su capacidad para hacer lo

anterior aumentará rápidamente

hasta que en un futuro previsible-

la magnitud de problemas que

tendrán capacidad de manejar irá a

la par con la capacidad de la mente

humana para hacer lo mismo.

3

Herbert Simon, 1957.

Premio Nobel de economia, 1978,

por sus trabajos en la Teoría de las

decisiones.

Introducción a la Inteligencia

Artificial - 2012

¿Cuáles son esas

máquinas?

4

Introducción a la Inteligencia

Artificial - 2012

16/03/2015

3

¿Qué es una computadora?

¿Es sólo una fábrica de números?

1 Tiene uno o más dispositivos de

Entrada (teclado, ...)

2 Tiene uno o más dispositivos de

salida (pantalla, ...)

3 Dispositivo de memoria (Ram, ...)

4 Una unidad aritmética

5 Una unidad de control

6 Un programa (instrucción de

ruptura de secuencia)

5

John Von Neumann

Introducción a la Inteligencia

Artificial - 2012

Una ayudita de los

amigos

6

Silogismos:

A quién madruga Dios le ayuda...

Quién madruga, duerme por la tarde...

Quién duerme por tarde, no duerme por la noche

Quién no duerme en la noche, sale de juerga

Conclusión: Dios ayuda a los que salen de juerga

Introducción a la Inteligencia

Artificial - 2012

16/03/2015

4

7

Modus ponendo ponens:

(modo que afirmando afirma)

Si ladra, es perro.

Ladra.

Entonces es perro.

Introducción a la Inteligencia

Artificial - 2012

Una ayudita de los

amigos

8

Modus tollendo tollens:

(modo que negando niega)

Si ladra, es perro.

No es perro.

Entonces No ladra..

Introducción a la Inteligencia

Artificial - 2012

Una ayudita de los

amigos

16/03/2015

5

¿y?

9

¿es posible que las

computadoras piensen?

• No, si uno define al pensamiento como

una peculiar actividad del cerebro.

• No, si uno define al pensamiento como

algo inescrutable, misterioso o mítico.

• Si, si uno admite que la pregunta debe

ser contestada por experimentación y

observación.

Introducción a la Inteligencia

Artificial - 2012

El Test de Turing

10

Test para establecer si una máquina

es o no inteligente. Consiste en

interrogarla por medio de una

teletipo

(sin contacto físico), el

evaluador no debe poder discernir

si el que responde es una máquina

o una persona

(Computing Machinery and Intelligence,1950)

http://es.wikipedia.org/wiki/Prueba_de_Turing

Introducción a la Inteligencia

Artificial - 2012

16/03/2015

6

El Test de Turing

Este planteo puede ser descripto en términos del

llamado “Juego de la Imitación” que traslada el

peso de la respuesta desde la esencia (ser o no

ser) a la apariencia (como si).

La Sala China pasa el test....

Experimento mental propuesto originalmente

por John Searle, 1980.

Introducción a la Inteligencia

Artificial - 2012

¿Se utiliza el test de Turing?

12

CAPTCHA

Completely Automated Public Test to tell

Computers and Humans Apart

Introducción a la Inteligencia

Artificial - 2012

16/03/2015

7

Algunas definiciones de

Inteligencia Artificial.

-Intentar hacer las computadoras más útiles y

entender los principios que hacen posible

la inteligencia. Winston

-Entender y estudiar científicamente los

procesos comunes que subyacen en el

pensar y el percibir ya sea en el hombre

como en la máquina. N. Nilsson

-Es la parte de la ciencia de la computación

que investiga los proceso de razonamiento

simbólicos y no algorítmicos y la

representación de conocimiento simbólica

para su uso en máquinas inteligentes.

Buchanan – Feigenbaum

-Hacer que las máquinas hagan cosas que

requerirían inteligencia si fueran hechas

por el hombre. M. Minsky

13

Introducción a la Inteligencia

Artificial - 2012

Definición dada por el

GIA – UTN (1987)

14

La Inteligencia Artificial es una forma

diferente de programar computadoras.

Introducción a la Inteligencia

Artificial - 2012

16/03/2015

8

Las definiciones de

inteligencia son

recursivas

Siguen empleando la palabra

inteligencia, que etimológicamente

deriva de la voz latina “legere” que

significa recolectar y por lo tanto

elegir lo que sirve y separarlo de lo

que no sirve, “intellegere” significa

elegir entre varias cosas

potencialmente útiles y quedarnos con

la mejor.

15

Introducción a la Inteligencia

Artificial - 2012

Áreas de la Inteligencia

Artificial

Procesamiento del Lenguaje Natural

Consulta inteligente de base de datos

Robótica

Programación Automática

Sistemas Expertos

Prueba automática de teoremas y

matemáticas simbólica

Problemas de optimización

combinatorios y de itinerarios.

Percepción y reconocimiento de patrones

Aprendizaje

etc...

16

Introducción a la Inteligencia

Artificial - 2012

Este documento contiene más páginas...

Descargar Completo

IIA-mod1-Fundamentos.pdf

Estamos procesando este archivo...

Estamos procesando este archivo...

Lamentablemente la previsualización de este archivo no está disponible. De todas maneras puedes descargarlo y ver si te es útil.

Lamentablemente la previsualización de este archivo no está disponible. De todas maneras puedes descargarlo y ver si te es útil.

Descargar

Estamos procesando este archivo...

Estamos procesando este archivo...

Lamentablemente la previsualización de este archivo no está disponible. De todas maneras puedes descargarlo y ver si te es útil.

Lamentablemente la previsualización de este archivo no está disponible. De todas maneras puedes descargarlo y ver si te es útil.